2025 年 10 月 29 日(為何是10月29日,因為日報都是介紹昨日的),AI 領域迎來了驚人的爆發。AI 程式碼編輯器 Cursor 推出 2.0 版本及自研模型,Cognition AI 則以極速 Agent 模型應戰。同時,OpenAI 的 Sora 開放了部分地區的免邀請註冊,Google 為開發者送上多重好禮,而 Anthropic 的研究更揭示了 AI 模型可能具備初步的「內省」能力。

今天的 AI 界真是熱鬧非凡!從開發者工具的重大升級,到影片生成模型的全面開放,再到關於 AI 自我意識的驚人研究,各大巨頭和新創公司都在加速奔跑,競爭的火藥味也越來越濃。

讓我們來快速盤點一下今天有哪些不容錯過的重磅消息。

不只是編輯器,Cursor 2.0 打造 AI 開發新範式

AI 優先的程式碼編輯器 Cursor 今天正式發布了其里程碑式的 Cursor 2.0 版本,帶來了全新的 Agent 介面和一個令人驚喜的「殺手鐧」:他們的第一款自研代理編碼模型——Composer。

根據 官方部落格 的介紹,Composer 是一個前沿模型,其最大亮點在於速度——比同等智慧水準的模型快上 4 倍。這意味著開發者可以獲得更即時的回應,大幅提升工作效率。

除了強大的內核,Cursor 2.0 的介面也進行了徹底革新。全新的「Multi-Agents」介面允許使用者在單一提示下,最多並行運行八個 Agent。這項功能利用 git worktrees 或遠端機器來避免檔案衝突,讓每個 Agent 都在獨立的程式碼庫副本中工作。想像一下,你可以同時讓多個 AI 助手分頭處理不同任務,或用不同模型解決同一個問題,然後挑選最佳方案,這簡直是開發者的夢想。

此外,更新日誌 還列出了多項改進,包括:

- 改進的程式碼審查:跨多個檔案的變更一目了然。

- 沙盒終端 (GA):在 macOS 上預設啟用,提升安全性。

- 團隊指令與語音模式:讓團隊協作和人機互動更加流暢。

速度之王登場!Cognition 發布 SWE-1.5 極速 Agent 模型

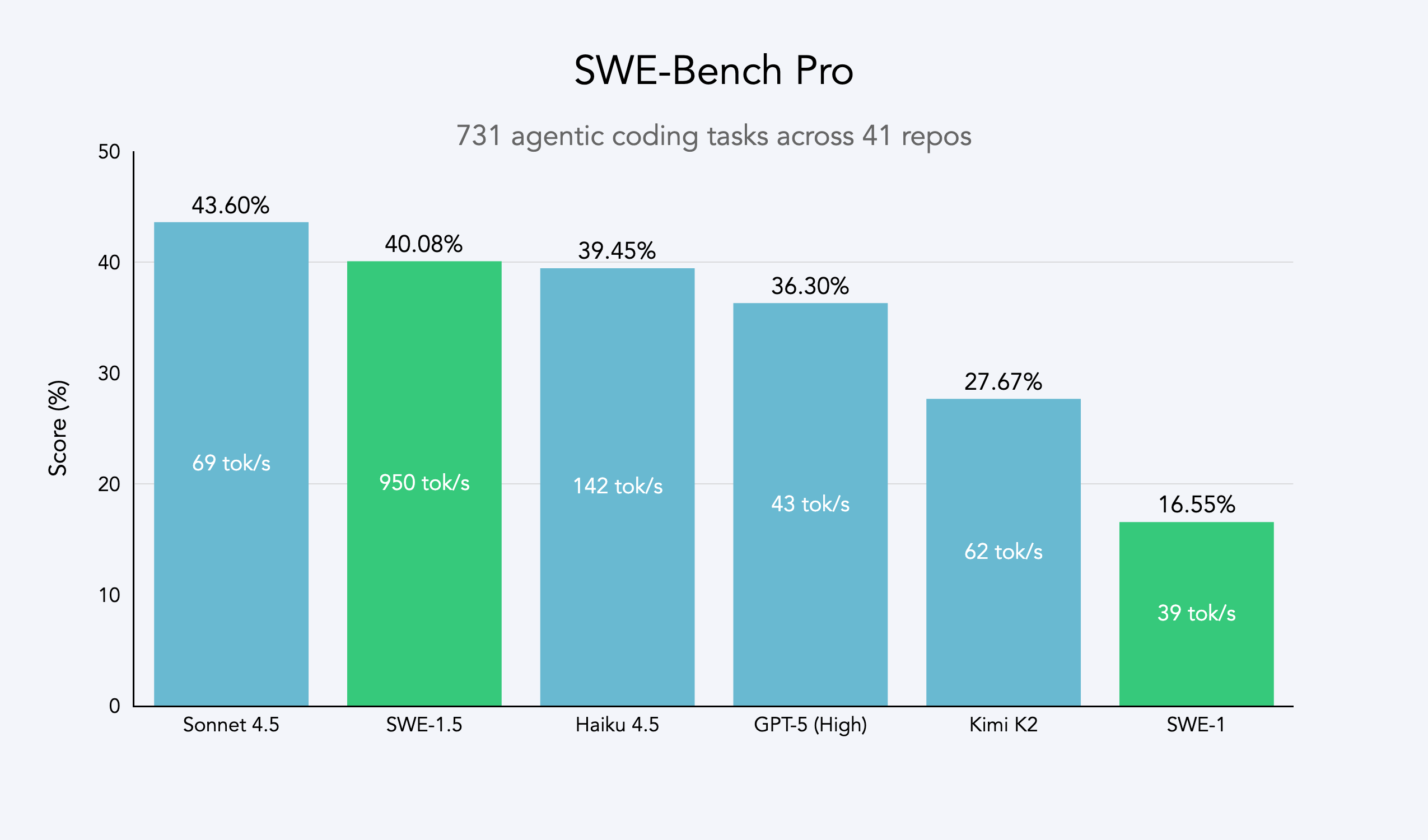

就在 Cursor 推出 Composer 的同時,以 AI 工程師 Devin 聞名的 Cognition AI 似乎也聞到了挑戰的氣味,迅速推出了他們最新的軟體工程模型 SWE-1.5。

如果說 Cursor 的 Composer 強調的是綜合體驗,那麼 SWE-1.5 的核心賣點就是一個字:快。

Cognition 與 Cerebras 合作,讓 SWE-1.5 的運行速度達到了驚人的 950 tok/s,這比 Haiku 4.5 快 6 倍,比 Sonnet 4.5 快 13 倍。這種速度讓許多過去需要數十秒的任務,現在能在 5 秒內完成。這場 AI 程式碼助理的競爭,顯然已經進入了「速度與激情」的階段。SWE-1.5 目前已在 Windsurf 平台上線。

Sora 影片生成自由玩!美加日韓限時免邀請碼

對於內容創作者來說,今天最大的好消息莫過於 OpenAI 的 Sora 終於放開了限制。

OpenAI 宣布,其備受矚目的文生影片應用 Sora,將暫時取消邀請碼要求。位於美國、加拿大、日本和韓國的用戶現在無需等待,可以直接下載 iOS 應用或訪問 sora.com 網站,使用 OpenAI 帳戶登入體驗。

這項「限時」優惠是 Sora 從封閉測試走向更廣泛應用的重要一步,旨在測試伺服器負載並收集更多用戶回饋。如果你身處上述地區,千萬別錯過這個搶先體驗頂級 AI 影片生成工具的機會!

Pro 用戶福利:OpenAI Pulse 功能登陸網頁版

除了 Sora 的好消息,OpenAI 也為其付費的 Pro 用戶帶來了更新。Pulse 功能現在已經可以在網頁端使用,讓 Pro 用戶在桌面環境下也能享受到更全面的服務。

你的非同步程式碼夥伴:Google 推出 Gemini CLI 的 Jules 擴充

Google 今天也為開發者社群帶來了一份大禮,發布了 Jules——一個為 Gemini CLI 設計的擴充功能。

Jules 就像一個可以非同步處理任務的「自主夥伴」。開發者可以在 Gemini CLI 中,透過簡單的指令將一些耗時的任務(如修復 Bug、在新的分支中進行更改)委派給 Jules 在背景處理。這讓開發者可以繼續專注於當前的核心工作,而不用中斷流程。你可以在 GitHub 上找到這個擴充功能。

開發者福音!Google Gemini 2.5 模型快取折扣飆升至 90%

Google 帶給開發者的好消息還不止於此。根據 官方消息,Google 大幅提升了 Gemini 2.5 模型的隱式快取折扣,從原來的 75% 提高到了 90%。

這意味著,對於重複或相似的 API 請求,開發者的成本將顯著降低。這項政策無疑會鼓勵開發者更高效地利用模型,並降低應用開發的門檻。

安全規則自己訂!OpenAI 釋出 gpt-oss-safeguard 開源模型

在 AI 安全領域,OpenAI 也邁出了重要一步,發布了名為 gpt-oss-safeguard 的開源安全模型。

這系列模型(分為 120b 和 20b 兩種大小)最大的特點是其靈活性。傳統的安全分類器通常基於預先定義的規則,而 gpt-oss-safeguard 允許開發者在運行時提供自己的安全策略。模型會利用其推理能力來解釋和應用這些自訂策略。

這種「自備策略」的設計,讓開發者可以根據自身應用的特定場景(例如遊戲論壇和金融應用的安全要求就截然不同)來劃定安全紅線,同時模型提供的「思維鏈」也能讓開發者理解其判斷依據,實現了更高的客製化和透明度。

Claude 在想什麼?Anthropic 研究揭示 AI 有限的「內省能力」

今天最引人深思的新聞,或許來自 Anthropic 發布的一篇**關於大型語言模型內省能力的研究**。

你是否曾好奇,當你問 AI「你在想什麼」時,它的回答是真的還是編的?Anthropic 的研究試圖科學地回答這個問題。他們透過一種名為「概念注入」的實驗技巧,將特定的「想法」(以神經活動模式的形式)植入到 Claude 模型中,然後觀察模型是否能察覺並報告這種「外來想法」。

研究發現,像 Claude Opus 4.1 這樣的頂尖模型,在某些情況下確實能夠意識到被注入的概念,並報告其內部認知過程的異常。雖然這種能力目前還很不穩定(成功率約 20%),但它首次提供了科學證據,表明 AI 可能具備了某種程度的、監控和報告自身內部狀態的能力。

這項發現對 AI 的透明度、可靠性乃至未來的人機互動模式,都具有極其深遠的影響。雖然我們離真正理解 AI 的「內心世界」還很遙遠,但這項研究無疑打開了一扇通往新世界的大門。